Tesla también suprime los radares frontales en los Model S y X, lo confía todo a Tesla Vision

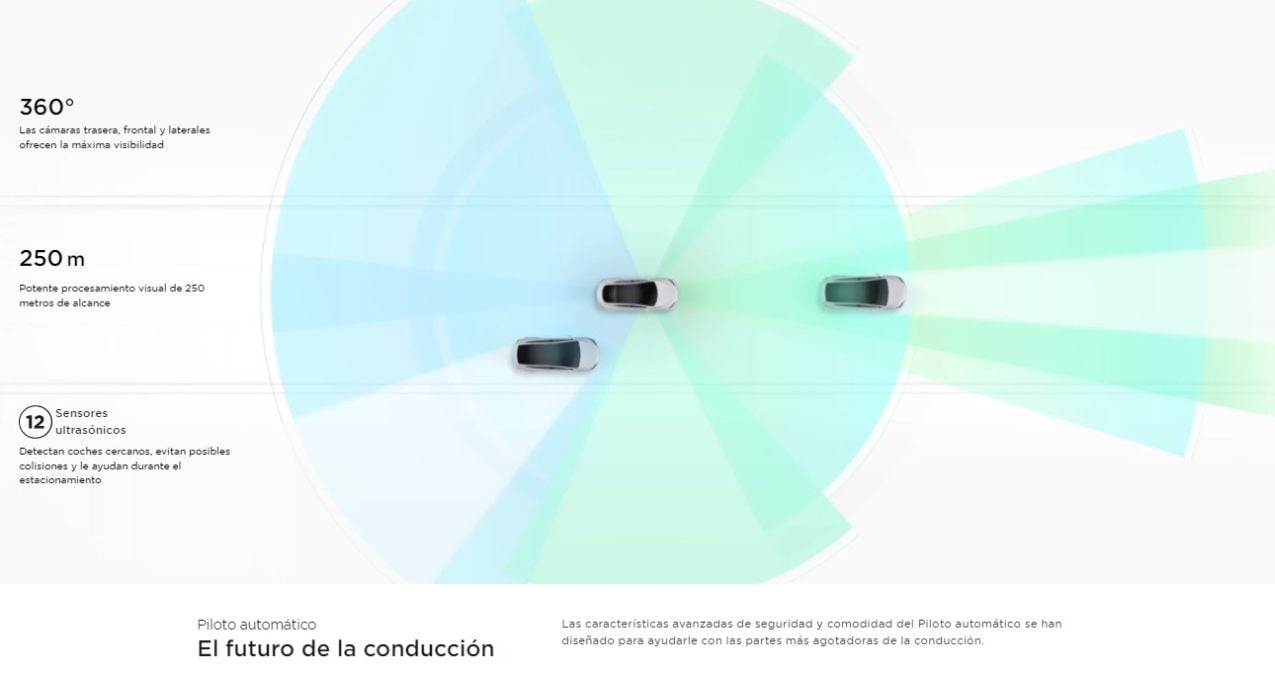

Continúa el despliegue progresivo del sistema Tesla Vision, por el cual los sensores que hacen “ver” al coche su mundo exterior se ciñe a cámaras de vídeo a 360 grados, y 12 sensores de ultrasonidos. El radar frontal sobra en esta concepción. Ya se había dejado de incluir en los Tesla Model 3/Y desde primavera de 2021, esta vez le toca a los Model S/X producidos desde febrero.

Los cambios afectan a todos los coches fabricados en Estados Unidos y con destino al mercado interior, pero también afecta a los Model S/X para exportación. Ya en la página web de Tesla no se hace mención alguna al radar frontal para los modelos de gama superior, tampoco salen de forma gráfica. Ídem para los Model 3/Y que llegan al mercado español, que proceden desde China, pues no equipan el radar frontal.

En teoría, la capacidad de “visión” frontal es superior a la del radar incluso en alcance, 250 metros con las cámaras. Sin embargo, el sistema Autosteer -dirección automática- está limitado a 130 km/h y la distancia de seguridad respecto al vehículo precedente se aumenta. El IIHS tardó en darle el beneplácito a esta tecnología en Model 3 y Model Y casi medio año. La NHTSA todavía no lo ve con buenos ojos.

La percepción de las cámaras y los radares frontales es muy diferente. Los seres humanos basamos nuestra percepción del mundo al volante en un 90% a través de nuestros ojos. Si bien estos solo captan luz visible -al igual que las cámaras-, interpretamos mejor lo que tenemos delante. La inteligencia artificial lo hace más rápido, pero tiene menor capacidad de razonamiento.

En cambio, los radares detectan objetos físicamente -incluso en el supuesto de ser invisibles- porque lanzan ondas que rebotan contra los cuerpos y son recibidas de nuevo. No solamente determinan la presencia de un objeto, también su posición. Para otros fabricantes el criterio de mayor seguridad es una mezcla de visión artificial y radar/LiDAR, lo que no perciba bien un sensor, que lo haga otro. El problema es la gestión de las discrepancias.

Con el sistema Tesla Vision -o Pure Vision– no hay discrepancias, las cámaras lo hacen casi todo, aunque el peso de la inteligencia artificial es superior para identificar las distancias. Los sensores de ultrasonidos solo tienen eficacia a muy corto alcance, así que sirven para las inmediaciones del vehículo exclusivamente.